お祝いで綾に行ってきました。楽しかった。すき焼き美味しかった。

18112018 chemoinformatics

週末は京都でkumainfoの座長の方々とお会いする機会があったので、予稿集を眺めて気になったところを質問してきました。

特に2B03の回帰式にdesolvation termが入っていたのでその意味を聞いたところHansch-Fujita equationのLogPではないかとのことでほう!となりました。ちなみに調べてみたら1984年くらいに同じこと書いてあった(p. 709)。

となるとPIEDAで出てくるDIはLogPとは関係がなく? スタッキングとかCH-πみたいな純粋なエンタルピックな量になってLLEとよい相関を示すことになるのかな?

一方でLLEは見かけの活性を排除しているわけではなくエントロピックな寄与を排除しているということになるが、これはエントロピックな寄与が一定という割と狭い条件でしか通用しないってことかもしれないですね。

konをいじるデザインも併せて考えると興味深いと思う。

このあたりの整理が出来たので良かった。

13112018 life

昨日は朝から気が滅入ってなんだかなーと思いつつ仕事をしていたのだが、久しぶりのコーヒータイムでいつもは顔を合わせない面子が集まって雑談を楽しんだので色々と刺激を受けた。 帰りの電車は論文読んだりする気分じゃなかったのでちょっと色々と考え事をしていたのでまとめておく。

自己評価はシニフィアンみたいなもので、他人からの評価がシニフィエなのだろう。

word2vecに見られるように、wordそのものに着目するよりもその周辺の単語によって、単語の意味が明確になる、つまり、単語そのものにはあまり意味がないように、自己評価そのものにはあまり意味がないように思う。きっと周りからの評価が自己の評価を形成するのだろう。

そういう風に考えると「誰をバスに乗せるか」とか「なにをするかより誰とやるか」という言葉はまた違った風に解釈できますね。

10112018 chemoinformatics

一通りの大きな発表とかが終わって、今週はゆっくり出来たので積んであった論文などを捌いていたら面白いものを見つけました。

konがどういう因子に支配されているかを調べているのですが、konを変化させるようなdrug designは望まれているけど難しいのでこういうメカニズム解明系の論文は夢があるし、読んでてワクワクしますね。素晴らしい。

ただ、結合過程を化学反応のアナロジーに例えるのはしっくりこなかった。TSって鞍点でしょ?デソルベーション過程って鞍点とみなしていいのかな?イメージできない。それから、apolarな部分のdeslolvationが律速過程みたいな図もちょっと納得できなかった。polarなほうが剥がしにくいし、論文中でもそうなってたしなぁ。

なんかもっと正しいアナロジーまたは解釈の余地は残っている気がする。

それからK4DDって面白そうな活動していますねっていうのと、論文のリンクを探すためにタイトルでググったら被引用論文のリンクがくっついていてグーグル凄いなと思いました。

知人に行くべきお店のリストを教えてもらったので基本的にはそれに従った。

雪風で味噌ラーメン。塩ラーメンも美味しいと聞いたのだがとりあえず味噌を。2日後に塩ラーメン食べに行ったが、 味噌も塩も両方美味しかった。今回食べたラーメンの中ではここが一番好みかな。

ホテルに戻って、北海道の日本酒を飲んだ。若手作らしい。飲みやすかった。

北大の銀杏並木。観光客が沢山いてみんな写真撮っていたので負けずに参戦した。

昼はスープカレーって決めていてピカンティに行ったら一時間待ちと言われて諦めた。

代わりにSAMAsというところで食べたが。トマトの酸味が強めな感じだった。

信玄は19時過ぎに行ったら1時間くらい並んだ。チャーハンも頼むべきとのことだったので頼んだけど、ラードの旨さと硬めのご飯を炒めた感じ。飲んだ後にはいいのかもしれないけど、特に感動はなかった。

味噌の気分ではなかったので塩ラーメンを頼んだが、まぁまあでした。味噌のほうが良かったのかなぁ。海外のお客さんもかなりいた。

ホテルに戻って二世古っていう日本酒をちびちびやりながら論文チェックしたり。

昼は札幌駅にあるヒリヒリ二号店へ。

ここのスープカレーは美味しかった。SAMAもそうだったけどチキンとご飯でお腹いっぱいに なってしまうのでご飯は別にいらないかなと思う。スープカレーにチキンも不要かなスープ飲みながら 野菜をかじるのが一番美味しいかも

夜はジンギスカンに日本酒をあわせるというお店。初日に行って振られているので 今回は予約して万全の態勢

予め火を起こして待っていてくれるようです。それからお通しが美味しかった。

美味しいお肉を食べて満足。

お昼はスアゲプラスという店。ベジカレー

五坪というたちのみスタイルの店。牡蠣が積まれている

日本酒を飲みながら焼き牡蠣が来るのを待つ。4つ頼んだら1つおまけしてもらった。

足らないので3つ追加。食べたらさっと帰る。

帰りに雪風で塩ラーメン。間違いのない美味しさ。

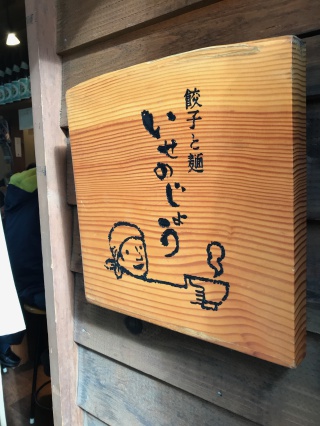

札幌駅のすぐ近くのイセノジョウで白菜ラーメン。あっさり目で美味しかった。

空港の空で味噌ラーメン

06112018 chemoinformatics

金出先生の講演面白かった。そしていろいろと考えさせられました。

ちゃんとした情報論の学会だとやはり理論的に説明することが求められるので発表を聞いていて楽しいし、勉強になりますね。インフォマティクスの頭にバイオとかケモとかマテリアルとかエトセトラエトセトラとかつくとなんか枠組みだけ借りてきてなんでそうなるのかちゃんと考えなかったり、期待感だけでうまくいくとか言っちゃうのがちらほら出てくるのはなんでなのかなー?と思います。

最近、ケモインフォマティクス系の発表でちょいちょい見かけるのが、構造式を紙に出力してCNNをつかって予測すると精度があがるとかいうやつとかね。chemceptionとかで

We demonstrate this by training deep convolutional neural networks to predict chemical properties that spans a broad range of categories including physical (solvation free energies), biochemical (in vitro HIV activity) and physiological (in vivo toxicity) measurements, without the input of advanced chemistry knowledge, but instead allowing the network to develop its own representations and features from the images it is trained on.

と書いてあるんだけど、これ単純にOCRできているだけじゃないの?としか思えないんですよね。文字認識してからテキストマイニングに描けるように、構造認識してから適当な予測モデルにかけているから精度ももともとの構造式をグラフ表現にしたものと同じくらいの精度しか出ないんだろうなーと。結局無駄な一手間加えただけなんじゃ?としか思えないんだけど、これに夢を感じるのなんでだろうねと思ってしまう。

もしかしたら、紙からもっとプリミティブというか量子化学的な特徴量を学習するのかもしれないけどそれって夢見過ぎなんじゃないのかなーと思う。結局構造式のグラフ表現だといろいろ化学的な事象を表現できないから色々別な表現方法提唱されているのにそういうのまるっと無視してAIとDLならうまくいくみたいな論調のひとはちょっとどうなのかなというか理論の部分知らなかったり(知る気もなかったり)するのがちょっとなー。

そんなことを考えながら飲んでいてメモ代わりにツイートしといたのが以下です。

DL的なアプローチで学問の階層性を上に辿れるのかって言うのはちょっと疑問。例えば二重結合の構造式をたくさん読んだところでそれがシグマとπの2つを意味していてそれぞれ意味合いとして違うということを理解できるのか疑問。

— kzfm (@fmkz___) 2018年11月5日

ケミストリー出身でバイオインフォやっている知り合いと盛り上がったディスはやっぱり「あいつら、アトムが玉としか認識できなくて、電子雲しらんから軌道の話すると思考停止するよね」みたいなのが10年前にあった。

— kzfm (@fmkz___) 2018年11月5日

何がいいたいかって言うとドメイン知識が不要っていうのは嘘よねってことかな。AIはよろしくやるからっていうのは表層漂うボウフラみたいなもんで、、、、ちゃんとリスペクトしないとカトンボのように扱われても同情せーへんでっていう

— kzfm (@fmkz___) 2018年11月5日

ちゃんとサイエンスをリスペクトしつつ、現実の世界で役に立つ研究をしたいなーと思いました。

06112018 chemoinformatics

半教師付き学習はトレーニング、テストが同じ分布のもので、転移学習はトレーニング、テストが異なる分布からくる(半)教師付き学習とみなせる

という話を聞いて、スッキリした。自分の中で理解が進んだ。転移学習の例として、室内で撮った写真をつかって室外の写真を予測するみたいなものを挙げていた。

キナーゼAの阻害データをトレーニングセットとしてキナーゼBの阻害を予測するのに転移学習を適用するってのはやっぱ分布が異なりすぎるんじゃなかろうか?または非選択的な阻害剤みたいなものしか予測できないとか。

04112018 chemoinformatics

学会に行っていい講演を聞けるとサイエンス脳になるし、ホテルに帰ってきてもやることなくて暇なんで論文でも読むかとかいう気分になるし、ついでにビール飲むとなんかエントリでも上げるかーってなるし、たまに学会に行くのはいいですね。

ちょっと読もうかなーと思って持ってきていた論文だけど、アブストとマテメソ、結論あたりを流し読みしただけです。

両方共同じ著者によるModelabilityに関するペーパーです。Interpreterbilityも重要ですけどModelabilityも同じくらい重要ですよね。というわけでこういうあたりはキャッチアップは欠かせないわけなんですが。

ただ、Modelabilityってどうなんかねーっていう疑問は残るんですよね。大体プロジェクトであるあるな典型的なシチュエーションって、より高活性(効き目の強い)を目指すことが多いと思うんです。

例えばプロジェクトの最高活性化合物がpIC50(数値が高いほうが強い)が7でpIC50が4-7のレンジでModelabilityの高いモデルが出来ました。となってもプロジェクトで目指すpIC50は8とか9だったりするんで、それoutlier予測じゃないか、そのモデルでいけんの?ってなると思うんですよね。まぁ予測モデルで4-7の範囲に入るのは信頼度高いから作る価値なしっていうネガティブスクリーニングに使うっていう方法あるかもしれないけど、それだとモデラーとして不本意じゃないかねというジレンマつらいのでは?

そうなると、ケミカルスペースをどう効率的に探索していくかというような、実験計画的なアプローチとか能動学習とかやりたがるようになると思うんだけどねー。レトロスペクティブにみてやるとプロジェクトの合成化合物は木構造を取るのでMCTSなんか使えるんじゃないかなーって期待するかもしれないんだけど、評価関数作れないし、可能な木構造爆発しちゃうし、なんか難しいよねーというため息しかでなかったりする。

尚、今飲んでいる札幌クラシックは「ホッホクルツ製法」で作られているからうまいらしいです。

03112018 chemoinformatics FMO

今日は飛行機の中でいくつか論文読んだのでメモを残しておこうと思ったんだけど、全部座席の網棚に置いてきてしまったらしい。邪魔だったから読み終わったのをパンフの網棚に突っ込んで最後に取り出すのを忘れたw 個人的には最後のJ.C.T.C.のやつが面白かったです、FMOにも触れられているのでSBDDerは目を通すべき。

ざっと目を通したんだけど embedding spaceってのが実態としてどんなもんなのかピンとこなかった。実装見て手を動かさないとわかんないのかなぁ。次元圧縮してどうすんだろ?

もう少し先行論文たどってみようかと思う。

キャッチーな絵を見てPAINSをSBDD的に解釈するのかなーと思い読んでみたんだけど、なんかよくわからない話だった。最近あまりライブラリとかHTSに興味が無いのも相まって読み飛ばしてしまった。構造出したらちゃんと解釈してもらわないとね。

E3FPの論文も ACSのほうを再度読み返してみた。部分構造に3次元情報を取り入れて細分類してECFPからどれくらいの精度が上がるかっていうのは興味ありますよね。このあたりはPLECにも拡張する余地ありそうだけど、それでどこまで上積みが見込めるかというところでしょうかね。

創薬わかってる感じやなーと思いつつ読んでいて読み終わってから共著にLilyの人が入ってるの気づいた。元論文紛失しちゃったから引用できないんだけど、FMOはFragmentationのやり方のせいで高精度の基底関数とかDiffuse関数を使いにくい(使っても精度が出にくい)、だから6-31G+分極関数くらいの基底関数の論文が多いみたいなことが書いてあったのと、精度出すには結論パートでダイナミクスを考慮しないといけないみたいなことが書いてあって、 ダイナミクス考慮するなら基底関数の精度そんなに要らないんじゃ? とちょっと思った。あと相互作用エネルギーにsolvation energy考慮していてあれってどの程度効いてくるのかなーとふと思いました。

って書いてたらあと1報読んだの思い出した。

これはRivaroxabanとかと同じような相互作用ですかね?FMOかけると楽しい案件だと思った。ただPDKAってAcidだから負電荷持ってるしMgイオンとも相互作用してるっぽいので計算する時にちょっと手間ですね、、、