rst2pdf で reStructuredText から PDF を生成するで日本語pdfが生成できるようになってもSphinxでは

[ERROR] pdfbuilder.py:120 BuildEnvironment instance has no attribute 'modules'

....

if self.config.pdf_use_modindex and self.env.modules:

AttributeError: BuildEnvironment instance has no attribute 'modules'

FAILED

とかいうエラーが出る(Sphinx1.02,1.03 + rst2pdf-0.15)

この場合にはrst2pdfの新しい版をsvnでインストール(0.16.dev-r2311をいれた)

あとはSphinxで日本語PDFを生成するの通りにやればうまくいく

中身は全然進んでないのに、出力だけは色々できるようになった ;-)

エキスパートPythonプログラミング

エキスパートPythonプログラミング

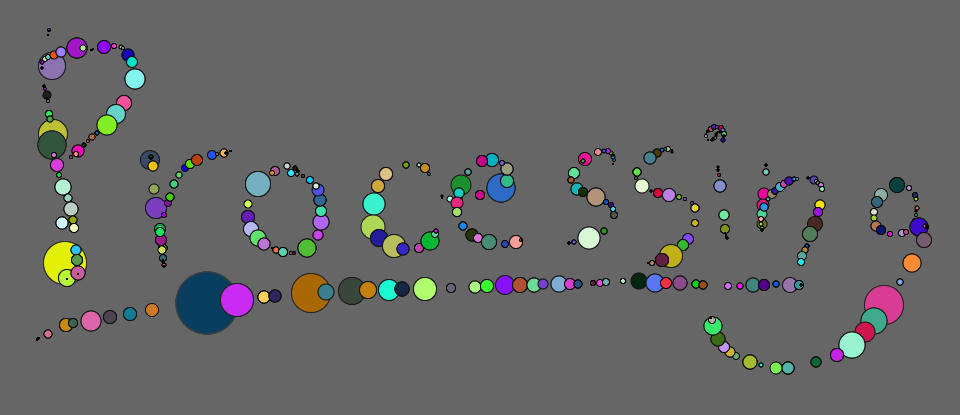

Built with Processing[Ver. 1.x対応版] -デザイン/アートのためのプログラミング入門

Built with Processing[Ver. 1.x対応版] -デザイン/アートのためのプログラミング入門 Visualizing Data

Visualizing Data ブックビジネス2.0 - ウェブ時代の新しい本の生態系

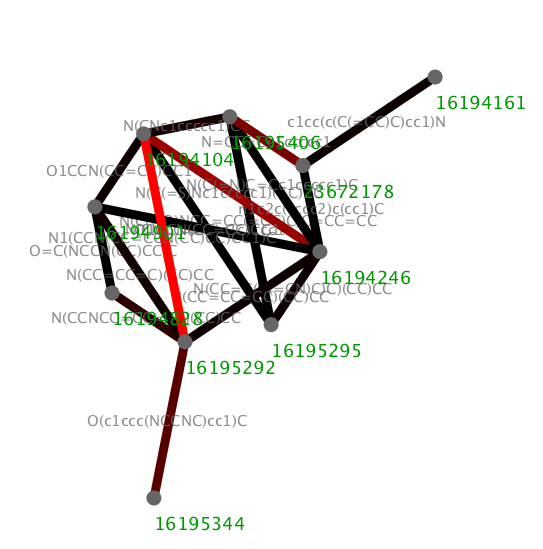

ブックビジネス2.0 - ウェブ時代の新しい本の生態系 Handbook of Chemoinformatics Algorithms (Chapman & Hall/Crc Mathematical and Computational Biology)

Handbook of Chemoinformatics Algorithms (Chapman & Hall/Crc Mathematical and Computational Biology) Chemoinformatics and Computational Chemical Biology (Methods in Molecular Biology)

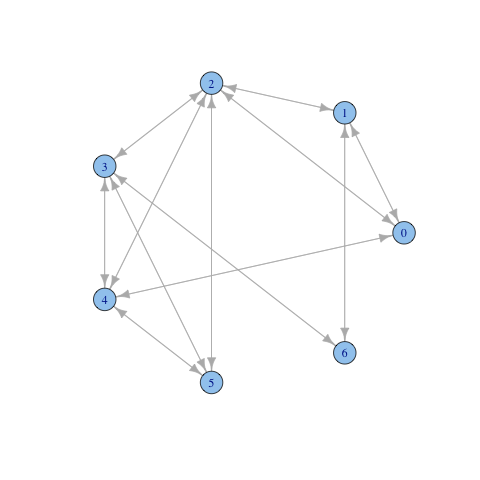

Chemoinformatics and Computational Chemical Biology (Methods in Molecular Biology) ネットワーク分析 (Rで学ぶデータサイエンス 8)

ネットワーク分析 (Rで学ぶデータサイエンス 8)

スーパーサイズド

スーパーサイズド